随着Deepseek大模型的横空出世,预计对整个工业领域会产生颠覆性的影响力,尤其针对边缘部署部分独创动态剪枝与量化技术,DeepSeek大模型支持在边缘设备低功耗运行(最低适配5 TOPS算力硬件),推理速度能够提升3倍。

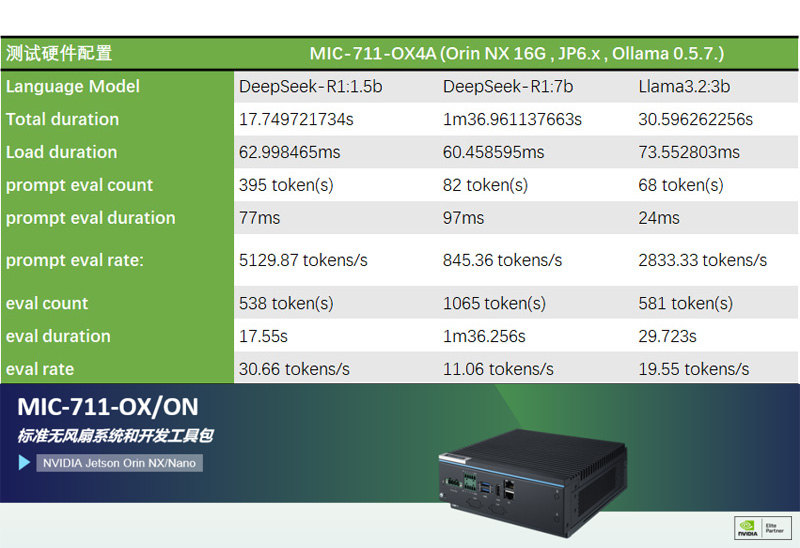

研华选择了多款基于英伟达技术的边缘AI产品,针对目前DeepSeek-R1 系列的不同蒸馏模型进行测试,下面让我们来看下最新测试数据!

微型边缘端推理应用

算力100 TOPS

推荐型号:

基于ARM平台AI Box:ICAM-540 /MIC-711 / MIC-713

支持DeepSeek-R1蒸馏模型版本:

☑ DeepSeek-R1-Distill-Qwen-1.5B

☑ DeepSeek-R1-Distill-Qwen-7B

☑ DeepSeek-R1-Distill-Llama-8B

测试型号:MIC-711

*同时在MIC-711-OX4A 开启了Super Mode来跑同样的模型, 在整体效能上有提升了将近25%, 这也表示了 Jetson super mode在AI应用上有明显的效能增强。

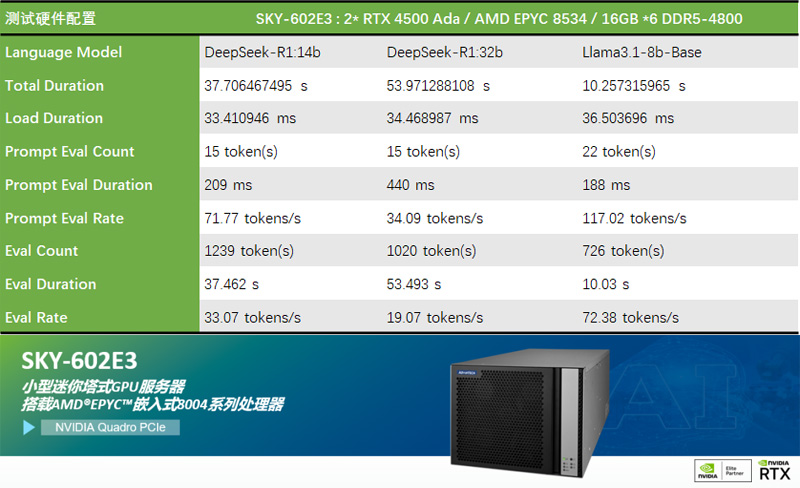

边缘端推理应用

算力100-500 TOPS

推荐型号:

基于ARM平台Edge AI Box:MIC-732/MIC-733/736

基于X86平台 Edge AI Box:MIC-770V3

Edge AI 服务器 :HPC-6240/HPC-7420/SKY-602E3 (支持1-4张GPU卡)

支持DeepSeek-R1蒸馏模型版本:

☑ DeepSeek-R1-Distill-Qwen-1.5B

☑ DeepSeek-R1-Distill-Qwen-7B

☑ DeepSeek-R1-Distill-Qwen-14B

☑ DeepSeek-R1-Distill-Llama-8B

测试型号:MIC-770V3

*DeepSeek-R1:32b于此系统配置下使用约18GB VRAM,可正常运行,但相同LLM model放在较高阶显卡上测试时VRAM使用达到21GB 故猜测模型会自动调整参数降低VRAM使用量,但在效能会有其影响。

高性能边缘AI服务器

算力500-1000+ TOPS

推荐型号:

Edge AI 服务器 :HPC-6240 /HPC-7420/SKY-602E3 (支持1-4张GPU卡)

支持DeepSeek-R1蒸馏模型版本:

☑ DeepSeek-R1-Distill-Qwen-14B

☑ DeepSeek-R1-Distill-Qwen-32B

☑ DeepSeek-R1-Distill-Llama-70B

测试型号:SKY-602E3

发表评论